آموزش الگوریتم های بهینه سازی در یادگیری ماشین + پیاده سازی در متلب

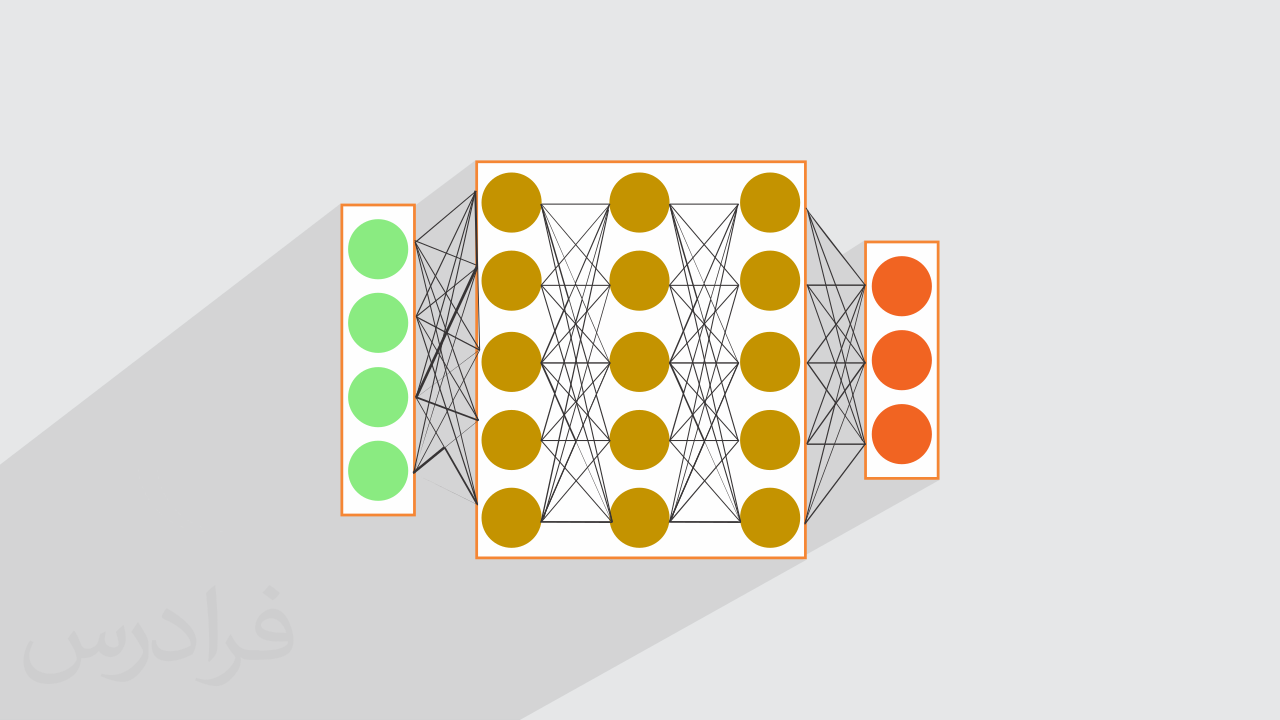

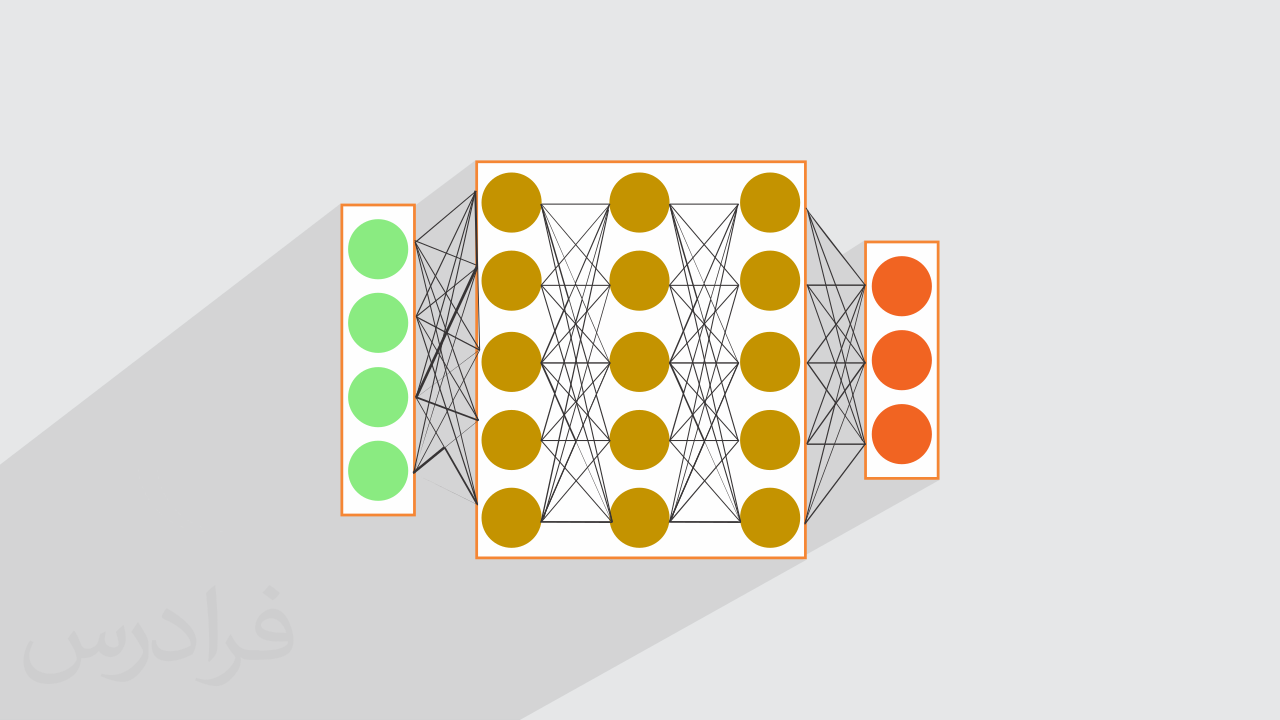

یادگیری ماشین در حقیقت الگوریتمی برای یاد گرفتن و تعمیم دادن از روی دادههای ثبت شده ورودی و خروجی است که هدف آن پیشبینی نتایج برای دادههای ورودی جدید است. میتوان یادگیری ماشین را به فرم تقریب تابعی تعبیر کرد که بردار ویژگیهای ورودی را به بردار ویژگیهای خروجی نسبت میدهد. توابع تقریب در یادگیری ماشین دارای فرمهای مختلفی است. در تمام این ساختارها، مجموعهای از پارامترهای تصمیم وجود دارند که باید به بهترین فرم ممکن تعیین شوند. یکی از مهمترین الگوریتمهای بهینهسازی عددی، گرادیان نزولی (Gradient Descent) است که در این آموزش به صورت دقیق و مفصل به این روش، ساختارهای مختلف و تعمیمهای مختلف آن میپردازیم. برای یادگیری دقیقتر، علاوه بر بیان تئوری مطالب و مفاهیم آنها، سعی میکنیم از طریق حل مسالههای مهم در یادگیری ماشین و کدنویسی در نرمافزار متلب (MATLAB) با انواع مختلف روشهای بهینهسازی مبتنی بر گرادیان آشنا شویم.

- فصل یکم: بهینهسازی تکمتغیره

- درس یکم: مقدمهای بر اهمیت بهینهسازی

- درس دوم: روش جستجوی شبکه

- درس سوم: کدنویسی روش جستجوی شبکه

- درس چهارم: الگوریتم نسبت طلایی

- درس پنجم: کدنویسی الگوریتم نسبت طلایی

- درس ششم: نمایش گرافیکی الگوریتم نسبت طلایی

- فصل دوم: بهینهسازی چندمتغیره با الگوریتم گرادیان نزولی

- درس هفتم: الگوریتم گرادیان نزولی

- درس هشتم: کدنویسی الگوریتم گرادیان نزولی

- درس نهم: کدنویسی بهینهسازی چندمتغیره با گرادیان نزولی

- درس دهم: الگوریتم Steepest Descent

- درس یازدهم: استفاده از گرادیان عددی برای بهینهسازی

- فصل سوم: تعمیمهای الگوریتم گرادیان نزولی

- درس دوازدهم: گرادیان نزولی با ممان MGD

- درس سیزدهم: گرادیان نزولی تطبیقی AdaGrad

- درس چهاردهم: سایر تعمیمهای گرادیان نزولی

- فصل چهارم: بهینهسازی چندمتغیره با الگوریتمهای بهینهسازی مرتبه دوم

- درس پانزدهم: الگوریتم بهینهسازی نیوتن

- درس شانزدهم: الگوریتمهای بهینهسازی گرادیان مزدوج و شبه نیوتن

- فصل پنجم: چند پروژه کاربردی

- درس هفدهم: رگرسیون خطی – مفاهیم و تولید داده

- درس هجدهم: بهینهسازی رگرسیون خطی با گرادیان نزولی

- درس نوزدهم: گرادیان نزولی تصادفی SGD

- درس بیستم: الگوریتم Levenberg-Marquardt و شبکه عصبی MLP

- درس بیستویکم: شبکه عصبی MLP

- درس بیستودوم: ماشین بردار پشتیبان (SVM) و تابع هزینه آن

- درس بیستوسوم: ماشین بردار پشتیبان با الگوریتم Adam

منبع:

فرادرس